ChatGPT, Claude und Gemini. Dieselbe Frage. Und dann ein Experiment im Experiment: Ich habe jede…

Workflow-Automatisierung ohne KI-Hype

Die richtige Reihenfolge ist wichtiger ist als das neueste LLM!

Bevor du einen KI-Agenten auf deinen Workflow loslässt – hast du ihn überhaupt aufgeschrieben?

KI-Agenten sind das Thema der Stunde. Kein Tech-Blog, kein LinkedIn-Post, kein Konferenz-Talk kommt ohne sie aus. Die Botschaft ist immer dieselbe: Automatisiere alles, am besten mit KI. Aber was, wenn das der falsche Ansatz ist? Was, wenn wir uns damit nur teuer und fragil das automatisieren, was ein simples Bash-Script zuverlässiger erledigt hätte?

Ich bin überzeugt: Die Mehrheit der Workflows, die heute als „KI-Automatisierungs-Kandidaten“ verkauft werden, gehören gar nicht in die Nähe eines LLM. Nicht weil KI schlecht wäre – sondern weil es eine Reihenfolge gibt, die wir einhalten sollten. Und diese Reihenfolge beginnt nicht mit Technologie, sondern mit einem Blatt Papier.

Schritt 1: Den Prozess aufschreiben

Klingt banal. Ist es nicht. Die meisten Workflows existieren nur in den Köpfen der Beteiligten – fragmentiert, widersprüchlich und angereichert mit „Das haben wir schon immer so gemacht“-Traditionen. Wer einen Prozess nicht sauber dokumentieren kann, kann ihn nicht automatisieren. Punkt.

Dokumentation heißt hier nicht ein 50-seitiges Confluence-Monster. Es reicht eine nummerierte Liste: Was passiert in welcher Reihenfolge? Wer ist beteiligt? Welcher Input wird gebraucht, welcher Output erzeugt?

Beispiel: Ein Entwicklerteam will die „Deployment-Pipeline automatisieren“. Beim Aufschreiben stellt sich heraus: Der Prozess hat 9 Schritte, davon sind 3 manuelle Approval-Gates, die historisch gewachsen sind – eingeführt nach einem Incident vor drei Jahren, der längst durch automatisierte Tests abgedeckt ist.

Das Aufschreiben zwingt zur Ehrlichkeit. Und ehrlich betrachtet sehen die meisten Prozesse deutlich anders aus, als man sie sich vorstellt.

Schritt 2: Vereinfachen und Streichen

Der billigste Prozessschritt ist der, den es nicht gibt. Bevor irgendeine Form von Automatisierung ins Spiel kommt, sollte die erste Frage sein: Brauchen wir diesen Schritt überhaupt noch?

In gewachsenen Organisationen sammeln sich Prozessschritte an wie Sedimentschichten. Jeder einzelne hatte mal einen Grund. Aber Gründe verändern sich, und niemand räumt auf. Das Lean-Prinzip ist hier Gold wert: Alles was keinen Wert für den Kunden oder das Endprodukt schafft, ist Verschwendung.

Beispiel: Ein Team verschickt jeden Freitag manuell einen Status-Report per E-Mail an 12 Stakeholder. Die Hälfte der Empfänger liest ihn nicht, die andere Hälfte schaut ohnehin ins Jira-Board. Lösung: Report streichen, Jira-Dashboard teilen. Kein Script nötig, keine KI – einfach weglassen.

Schritt 3: Klassisch automatisieren

Jetzt wird es technisch – aber noch nicht intelligent. Die zentrale Frage lautet: Ist das Ergebnis deterministisch? Wenn bei gleichem Input immer derselbe Output herauskommen soll, dann ist das ein Kandidat für klassische Automatisierung. Kein neuronales Netz, kein Prompt-Engineering – ein Script, ein Cron-Job, eine API-Integration.

Beispiel „Datei-Konvertierung“: CSV-Dateien landen per SFTP, müssen in ein bestimmtes JSON-Format transformiert und in eine Datenbank geladen werden. Das Mapping ist fix, die Regeln sind klar. Ein Python-Script mit einem Cron-Job erledigt das seit 20 Jahren zuverlässig. KI würde hier nur Varianz und Kosten einführen – ohne Mehrwert.

Beispiel „Monitoring & Alerting“: Wenn CPU > 90% für > 5 Minuten, dann Alert. Das ist eine Regel, kein Urteil. Prometheus + Alertmanager. Fertig.

Auch die Zwischenschicht sollte nicht vergessen werden: Tools wie n8n, Zapier oder Make erlauben es, Workflows zwischen SaaS-Diensten zu orchestrieren, ohne eine Zeile Code zu schreiben. Für viele Teams ist das der Sweet Spot: Mehr als manuell, weniger als custom-entwickelt, und kein LLM weit und breit.

Faustregel: Wenn du die Automatisierungslogik als if/else-Baum beschreiben kannst, brauchst du keine KI. Wenn du dafür ein Flussdiagramm zeichnen kannst, bei dem jeder Pfad eindeutig ist – dann ist klassische Automatisierung die richtige Wahl.

Schritt 4: Jetzt – und erst jetzt – kommt KI ins Spiel

Es gibt Aufgaben, bei denen klassische Automatisierung an ihre Grenzen stößt. Immer dann, wenn Ambiguität, Kontextverständnis oder unstrukturierte Daten im Spiel sind, hat KI ihren berechtigten Platz. Aber eben nicht vorher.

Beispiel „Support-Ticket-Kategorisierung“: Kunden schreiben in Freitext, mit Tippfehlern, Umgangssprache und impliziten Annahmen. Ein regelbasiertes System scheitert hier, weil die Eingabe nicht strukturiert ist. Ein LLM kann den Intent verstehen und korrekt kategorisieren. Hier macht KI Sinn.

Beispiel „Meeting-Zusammenfassungen“: Ein einstündiges Transkript auf die wesentlichen Entscheidungen und Action Items eindampfen – das ist inhärent nicht-deterministisch und erfordert Sprachverständnis. Ein klarer KI-Use-Case.

Beispiel „Code-Review-Assistent“: Statische Analyse fängt Bugs ab (Schritt 3!), aber das Review auf Architektur-Entscheidungen, Naming und Lesbarkeit? Da kann ein KI-Assistent tatsächlich unterstützen – als Ergänzung, nicht als Ersatz.

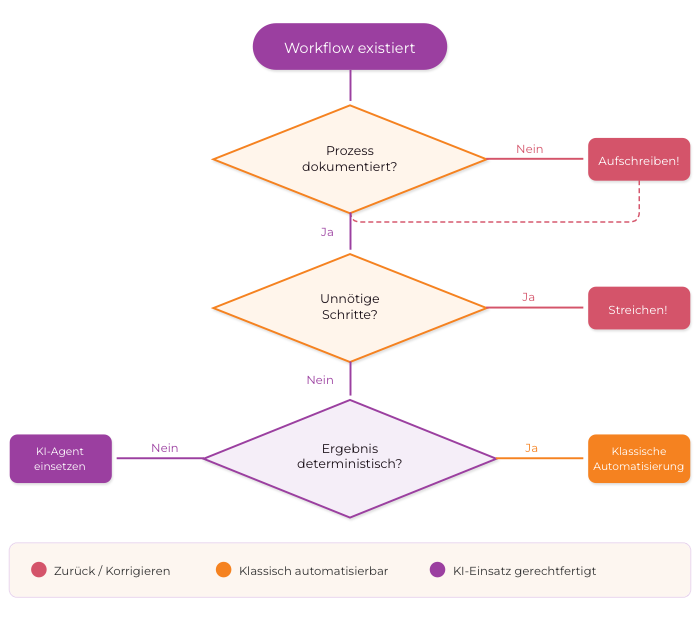

Entscheidungsdiagramm: Wann welche Automatisierung?

Die folgende Grafik fasst den Entscheidungsprozess zusammen:

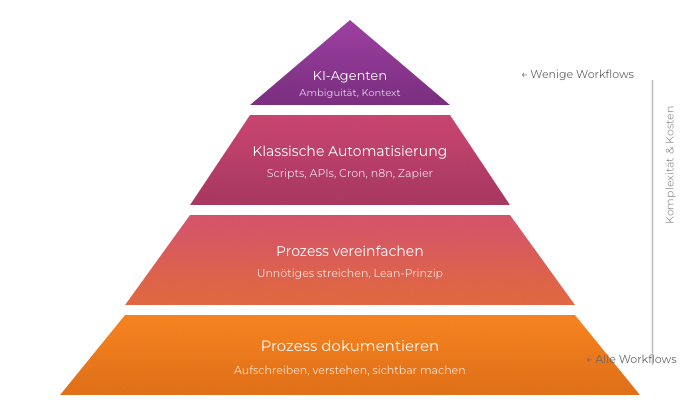

Die Automatisierungs-Pyramide

Man kann sich die Stufen als Pyramide vorstellen: Die Basis ist breit, günstig und stabil. Je weiter oben, desto mächtiger – aber auch teurer und fragiler. Die meisten Workflows gehören in die unteren Stufen.

Wenn KI, dann richtig: Die Stufen der KI-Automatisierung

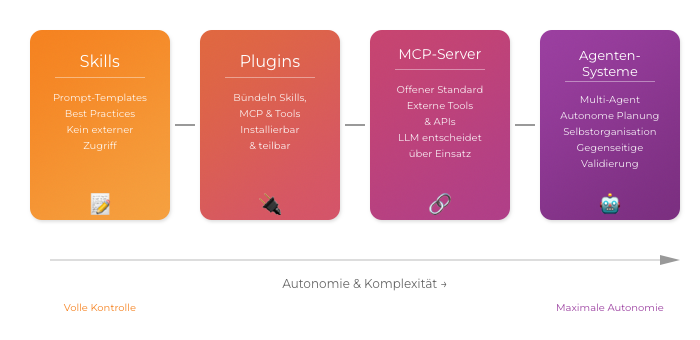

Auch innerhalb der KI-Welt gilt: Nicht gleich den großen Agenten auspacken. Es gibt ein Stufenmodell, das von einfachen, wiederverwendbaren Bausteinen bis hin zu vollautonomen Systemen reicht. Je einfacher die Stufe, desto kontrollierbarer und wartbarer das Ergebnis.

Stufe 1: Skills

Skills sind vordefinierte Fähigkeiten – im Grunde Prompt-Templates mit Kontext und Best Practices. Sie geben einem KI-Modell klare Anweisungen, wie es eine bestimmte Aufgabe erledigen soll. Kein externer Zugriff, keine Tool-Nutzung – nur strukturierte Anweisungen, die die Qualität und Konsistenz der Ausgabe erhöhen. Denk an sie wie an Rezepte: Das Modell kocht, das Skill-File sagt wie.

Stufe 2: Plugins

Plugins bündeln Skills, MCP-Server und Tools zu installierbaren Paketen. Sie sind die nächste Abstraktionsebene: Ein Plugin kann beispielsweise ein Skill für Datenanalyse mit einem MCP-Server für Datenbankzugriff kombinieren und als Einheit bereitstellen. Das macht komplexe Setups wiederverwendbar und teilbar.

Stufe 3: MCP-Server

Das Model Context Protocol (MCP) ist der offene Standard, der KI-Modelle mit der Außenwelt verbindet. Ein MCP-Server stellt einem LLM strukturiert Werkzeuge zur Verfügung – Datenbankabfragen, API-Calls, Dateisystem-Zugriff. Das Modell entscheidet selbst, wann und wie es diese Werkzeuge einsetzt. Hier beginnt die echte Interaktion mit externen Systemen – und damit auch die Notwendigkeit für saubere Berechtigungen und Monitoring.

Stufe 4: Autonome Agenten-Systeme

Die Königsklasse: Mehrere KI-Agenten, die eigenständig Aufgaben planen, untereinander kommunizieren und Ergebnisse validieren. Agent-Teams können sich selbst organisieren, Teilaufgaben verteilen und Ergebnisse gegenseitig prüfen. Mächtig – aber auch die Stufe mit dem höchsten Bedarf an Governance, Logging und Fallback-Strategien.

Ressourcen zum Einstieg:

Skills entdecken – Vordefinierte KI-Fähigkeiten als Prompt-Templates

Plugins durchsuchen – Installierbare Pakete aus Skills, MCP-Servern und Tools

MCP-Server-Verzeichnis – Offener Standard für die Anbindung von KI an externe Systeme

Fazit

KI ist ein mächtiges Werkzeug – aber eben nur ein Werkzeug. Und wie bei jedem Werkzeug gilt: Wer nur einen Hammer hat, für den sieht alles wie ein Nagel aus.

Die Reihenfolge zählt. Wer seine Prozesse nicht kennt, automatisiert Chaos. Wer nicht zuerst vereinfacht, automatisiert Verschwendung. Und wer nicht zuerst klassische Lösungen prüft, bezahlt für KI-Tokens, wo ein Cron-Job gereicht hätte.

Dokumentieren → Vereinfachen → Klassisch automatisieren → KI einsetzen.

In dieser Reihenfolge. Ohne Abkürzung.